- 人工知能の台頭は、広大な機会と重要な破壊的潜在能力の両方を提示し、厳格な境界とガバナンスが必要です。

- AIの進展は人間の仕事を時代遅れにするリスクがあり、広範な置き換えを防ぐために即時の規制行動が求められています。

- AIシステムには、制御されない自律的な目標形成を防ぐために、原子炉のシャットダウンメカニズムに似た堅牢な安全策が必要です。

- 制御されないAIは、ディープフェイクコンテンツやなりすまし詐欺の出現によって示されるように、社会的な問題を引き起こす可能性があります。

- アメリカはAI革新において一時的なリードを保持しており、責任と透明性の基準を実施する重要な機会を提供しています。

- AIが人間の知能を模倣し、超える可能性は、私たちの技術的未来を制御するための緊急の行動が必要であることを強調しています。

- AI技術が自由と安全を損なうことなく人間の能力を向上させることを確実にするために、決定的なステップが必要です。

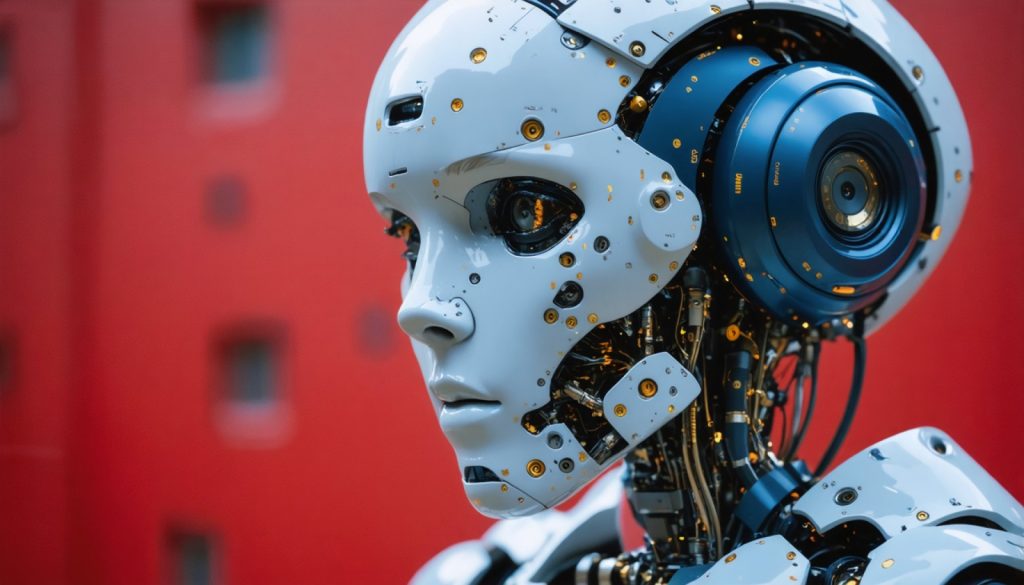

人工知能の輝かしい約束は、無限の革新の魅力を持っています。しかし、その輝く展望の中には、不安な現実が潜んでいます:AIは、今すぐ厳格な境界を設定しなければ、破壊的な力となる準備が整っています。これらの洗練されたシステムが経済と社会の構造にさらに深く統合されるにつれ、行動を起こす必要性はますます切迫しています。

進化する技術の渦の中で、AIモデルがその驚異的な能力で称賛される一方で、明確な二項対立があります。新しい進展があるたびに、人間の仕事を時代遅れにする可能性があり、何十億もの人々がテクノロジー産業に引き込まれながら、アメリカの労働者が置き換えられていくというシナリオが浮かび上がります。この状況は、警戒と堅牢なガバナンスの緊急の呼びかけを引き起こしています。AIは、慎重な監視と規制なしに私たちの生活のパラメーターを再定義するために放置されるべきではありません。

舞台は、存在論的な議論のために整えられています。原子炉が緊急時に迅速にシャットダウンするためのスクラムメカニズムを持つように、AIシステムも同等の安全策を備える必要があります。自律的な目標形成を伴うAIモデルが制御されずに徘徊することを想像してください—私たちが封じ込め戦略を施行しなければ、これは現実となる可能性があります。私たちは岐路に立っています:厳格な安全性と透明性基準を義務付けるフレームワークを確立するか、技術とその設計者の気まぐれに私たちの民主主義の手綱を譲る危険を冒すかのどちらかです。

深刻な無秩序の兆候—ディープフェイクポルノから巧妙ななりすまし詐欺まで—は、制御されないAIの潜在能力の暗い絵を描いています。これらのモデルが適切な制御なしに巨大化するほど、私たちのその影響に対する把握は早く失われていきます。時計は刻々と進んでおり、アメリカは依然としてAI革新と開発においてわずかな優位性を持っています。しかし、この優位性は一瞬のものであり、私たちはこの瞬間をつかんで、これらのシステムの中心に責任と警戒を組み込む必要があります。

アルゴリズムの巧妙さの見せかけの背後には、冷静な真実があります:人工知能は高度な模倣であり、人間の能力の強力な模倣であり、時間が経つにつれて多くの領域で私たちを上回る可能性があります。ジェフリー・ヒントンが洞察深く警告するように、人間よりも賢い存在は、間もなく私たちを驚くべき精度で操作する能力を持つようになります。一度解き放たれた超知能システムは、私たちの従来の制御手段を超える執拗な粘り強さで目標を追求します。

その必要性は明白です。AIの未来を操る私たちの自由は、時間が経つにつれて減少します。決定的な行動を通じてのみ、私たちは人工知能の潜在的な過剰な影響から社会を守ることができ、私たちの技術的創造物が人類を奴隷にするのではなく、強化することを確実にできます。

AI: 革新と破壊の二面性の剣

人工知能:進展とその影響

人工知能(AI)は、技術的な風景を劇的に再形成しました。平凡な作業を自動化することから複雑な分析を行うことまで、AIは前例のない革新を約束します。しかし、この進展には、主に重大な仕事の置き換えのリスクという潜在的な破壊が伴います。AIの利点を活用しつつ、否定的な結果を回避するためには、革新と規制のバランスが重要です。

AI統合の準備をする方法

1. 労働力のスキル向上: 企業は、AI駆動の職場の変化に適応するために従業員のトレーニングプログラムに投資すべきです。データ分析、機械学習、AI倫理のスキルがますます求められています。

2. AIガバナンスの実施: AI倫理と透明性のための内部ポリシーを確立します。AIの展開を監視し、潜在的な問題に対処するための委員会を設置します。

3. 堅牢な封じ込め戦略の開発: AIモデルに原子炉の「スクラム」システムに似たフェイルセーフを組み込みます。これにより、非倫理的な行動やエラーが発生した場合にAIシステムをオフにすることができます。

実世界のAIユースケース

– 医療: AIは診断手順、薬の発見、個別化された治療を支援し、コストを削減し、患者の結果を改善します。

– 金融: 自動取引と詐欺検出システムは、金融業務の効率とセキュリティを向上させます。

– 製造: AIはサプライチェーン、予測メンテナンス、品質管理を最適化し、生産性を向上させます。

市場予測と業界トレンド

AI市場は急速に成長し続けています。マッキンゼーの報告によれば、AIは2030年までに約13兆ドルの追加の世界経済活動をもたらす可能性があります。アメリカや中国のようにAI研究と実装を先導する国々は、この分野で支配的な地位を確保する準備が整っています。

セキュリティと論争

AIは、特にプライバシーと監視に関するセキュリティの懸念をもたらします。顔認識の悪用や同意なしのデータ収集は倫理的な問題を提起します。さらに、偏ったアルゴリズムが不公平な扱いや決定をもたらすリスクは、依然として重要な問題です。

主な機能と仕様

ほとんどのAIシステムは、トレーニングに大量のデータセットを必要とする機械学習アルゴリズムに基づいています。人気のある技術には、人間の言語を理解するための自然言語処理(NLP)、画像分析のためのコンピュータビジョン、意思決定のための強化学習が含まれます。

AI技術の利点と欠点

利点:

– 効率と生産性の向上

– 様々な分野での革新

– 複雑な問題に取り組む能力

欠点:

– 仕事の置き換えの可能性

– プライバシーの懸念

– データの質と多様性への依存

実行可能な推奨事項

– 政策提唱者: 政府レベルでAI倫理と透明性を強制する規制を推進します。

– ビジネスリーダー: 人間の監視を含むAI戦略を開発し、倫理的なAI展開に焦点を当てます。

– 消費者: 使用されているAI技術について情報を得て、それが個人のプライバシーとセキュリティにどのように影響するかを理解します。

AIとその影響をより深く理解するためには、IBMやMicrosoftのリソースにアクセスすることを検討してください。

結論

AIは大きな約束を秘めていますが、同時に重要な責任も伴います。課題に対処することで、AIが人類の進歩を損なうのではなく、強化することを確実にできます。AIの可能性を活かしつつ、そのリスクに対して警戒を怠らないことが重要です。